基于对抗训练的深度学习模型优化与应用研究

文章摘要:基于对抗训练的深度学习模型优化与应用研究,是当前人工智能领域的重要方向之一。随着深度神经网络在图像识别、自然语言处理、自动驾驶与医疗诊断等领域的广泛应用,模型在复杂环境中的鲁棒性与安全性问题日益凸显。对抗样本的出现揭示了深度模型在高维空间中的脆弱性,也推动了对抗训练理论与方法的不断演进。本文围绕对抗训练的理论基础、关键优化策略、典型应用场景以及未来发展趋势四个方面展开系统论述,深入分析对抗训练如何通过构建扰动样本增强模型的泛化能力与安全性能。同时,结合工程实践与算法创新,探讨对抗训练在真实环境中的部署挑战与解决思路,为推动深度学习模型在安全可靠方向上的持续优化提供系统化参考。

一、对抗训练理论基础

对抗训练起源于对抗样本的研究。研究者发现,在输入数据中加入微小但经过精心设计的扰动,便可能导致深度神经网络产生严重误判。这种现象揭示了模型在高维特征空间中的不稳定性,也促使学界重新审视深度学习的泛化机制。从理论层面看,对抗训练是一种最小化最大风险的优化问题,其核心在于在训练过程中引入“最坏情况”的扰动样本,以提升模型在极端输入下的稳健性。

在数学形式上,对抗训练通常被表述为一个双层优化问题。外层优化目标是最小化模型在对抗扰动下的损失函数,而内层则寻找使损失最大化的扰动向量。这种极小极大问题体现了博弈思想,使模型在训练阶段便经历“攻击”与“防御”的对抗过程,从而在参数空间中找到更具鲁棒性的解。

此外,对抗训练还与正则化理论存在紧密联系。通过在输入空间引入约束扰动,可以视为对模型梯度进行约束,从而抑制过度敏感的方向。这种机制有助于平滑决策边界,降低模型对局部噪声的依赖程度,提高整体泛化性能。因此,从理论基础角度看,对抗训练不仅是安全防御手段,也是提升模型稳定性的有效路径。

进一步而言,对抗训练推动了鲁棒优化理论的发展。鲁棒优化强调在不确定环境下求解最优解,而对抗样本正是对输入不确定性的具体刻画。通过将鲁棒优化思想融入深度学习框架,研究者构建出更加稳定的学习范式,为安全人工智能奠定了理论基础。

二、关键优化策略创新

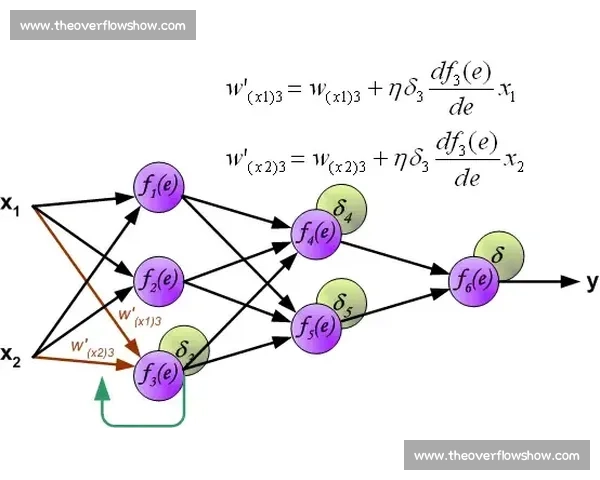

在具体实现层面,对抗训练的优化策略直接决定模型性能。经典方法通常基于梯度信息生成扰动样本,通过快速梯度符号法或多步迭代方法生成对抗数据,并将其纳入训练流程。这类方法计算效率较高,适用于大规模数据场景,但在强攻击环境下仍存在一定局限。

为提升对抗强度与训练稳定性,研究者提出多步对抗训练策略,通过迭代方式逼近最优扰动。此类方法在提升鲁棒性的同时,也增加了计算成本。因此,在实践中常结合混合训练策略,在标准样本与对抗样本之间动态平衡,以保证精度与鲁棒性的协调发展。

近年来,基于自适应学习率与正则化机制的改进策略也不断涌现。例如,通过引入梯度裁剪、权重衰减与标签平滑技术,可以缓解对抗训练中出现的梯度爆炸与过拟合问题。这些优化措施在保持模型表达能力的同时,增强了训练过程的稳定性。

此外,生成对抗网络思想的引入,使对抗样本生成过程更加多样化。通过构建对抗生成模块,可以在训练过程中持续产生高质量扰动样本,形成动态博弈机制。这种策略不仅提升了鲁棒性能,也为模型结构设计带来新的创新方向。

三、典型应用场景拓展

在计算机视觉领域,对抗训练被广泛应用于图像分类与目标检测任务。通过在训练阶段引入扰动图像,可以显著降低模型在恶意攻击下的误判率。这对于自动驾驶、安防监控等关键场景具有重要意义,因为视觉系统的错误识别可能带来严重后果。

在自然语言处理领域,对抗训练同样发挥着关键作用。文本分类、情感分析与机器翻译模型在面对词汇替换或语义扰动时容易出现性能下降。通过对嵌入向量进行扰动训练,可以提升模型对语义变化的适应能力,从而增强语言理解系统的鲁棒性。

在医疗影像与金融风控等高风险领域,对抗训练为模型安全提供了重要保障。医疗诊断模型在面对图像噪声或设备差异时,若缺乏鲁棒性,可能导致误诊风险。通过对抗训练,可以提高模型对复杂环境变化的适应能力,提升决策可靠性。

此外,在联邦学习与边缘计算场景中,对抗训练也逐渐成为保障数据安全的重要工具。在分布式环境下,模型可能遭受数据投毒攻击。通过引入对抗鲁棒机制,可以提升系统整体安全水平,为多方协作学习提供技术支撑。

四、未来趋势与挑战

尽管对抗训练取得了显著成果,但其计算成本仍然较高,特别是在大规模模型与海量数据场景下。如何在保证鲁棒性的同时降低训练时间与资源消耗,是未来研究的重要方向。轻量化对抗策略与高效扰动生成算法将成为突破口。

其次,对抗训练与模型泛化之间的平衡问题仍需深入探索。过强的对抗训练可能导致模型在标准样本上的性能下降。因此,如何设计自适应机制,在不同阶段动态调整扰动强度,是实现高质量鲁棒模型的关键。

同时,随着多模态模型与大规模预训练模型的发展,对抗训练面临新的挑战。跨模态数据的扰动生成与鲁棒优化问题更加复杂,需要结合表示学习与结构约束进行系统研究。这为人工智能安全领域带来了新的课题。

最后,从伦理与安全治理角度看,对抗训练不仅是技术问题,也是社会问题。随着人工智能系统广泛应用于公共领域,构建可解释、可验证的鲁棒模型体系显得尤为重要。未来研究需在技术创新与安全监管之间形成协同机制。

总结:

综上所述,基于对抗训练的深度学习模型优化与应用研究,既是理论探索的前沿方向,也是工程实践的重要课题。从理论基础到优化策略,再到多领域应用与未来趋势,对抗训练构建了一个融合博弈思想与鲁棒优化理论的技术体系,为提升模型安全性与泛化能力提供了系统解决方案。

面向未来,对抗训练将与高效计算、跨模态学习以及安全治理深度融合,在保障人工智能系统稳定可靠运行方面发挥更加关键的作用。通过持续的理论创新与实践验证,深度学习模型将在安全、鲁棒与高性能之间实现更加协调的发展。

电子pg,pg娱乐国际,PG平台,PG电子官方网站,PG电子平台官网,pg国际